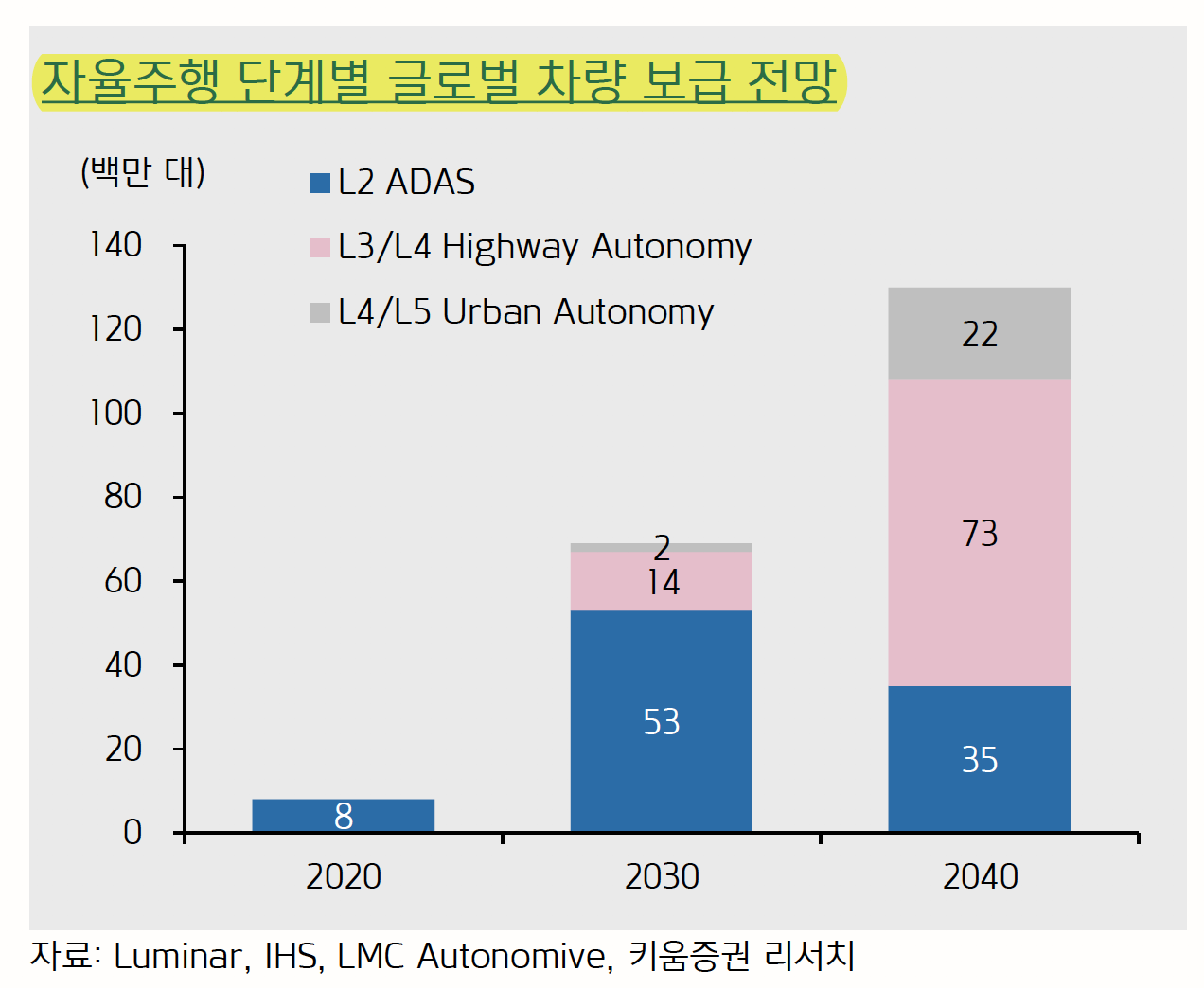

- FSD 기능 확대 기대

- ADAS 기능이 대중화 되며 교통사고 사망숫자 지속적인 감소세

- 기아차는 3Q 실적 발표에서 당사의 신차 구매시 안전 기능 옵션 채택율이 증가했음을 언급. 드라이브 와이즈 프로그램(SCC, 고속도로 주행보조 기능 등 포함) 채택율은 3Q20 기준 각각 71%, 83%로 (vs 3Q19 K5 23%, 쏘렌토 58%) YoY 상승, HUD 채택율도 24%, 34%를 기록

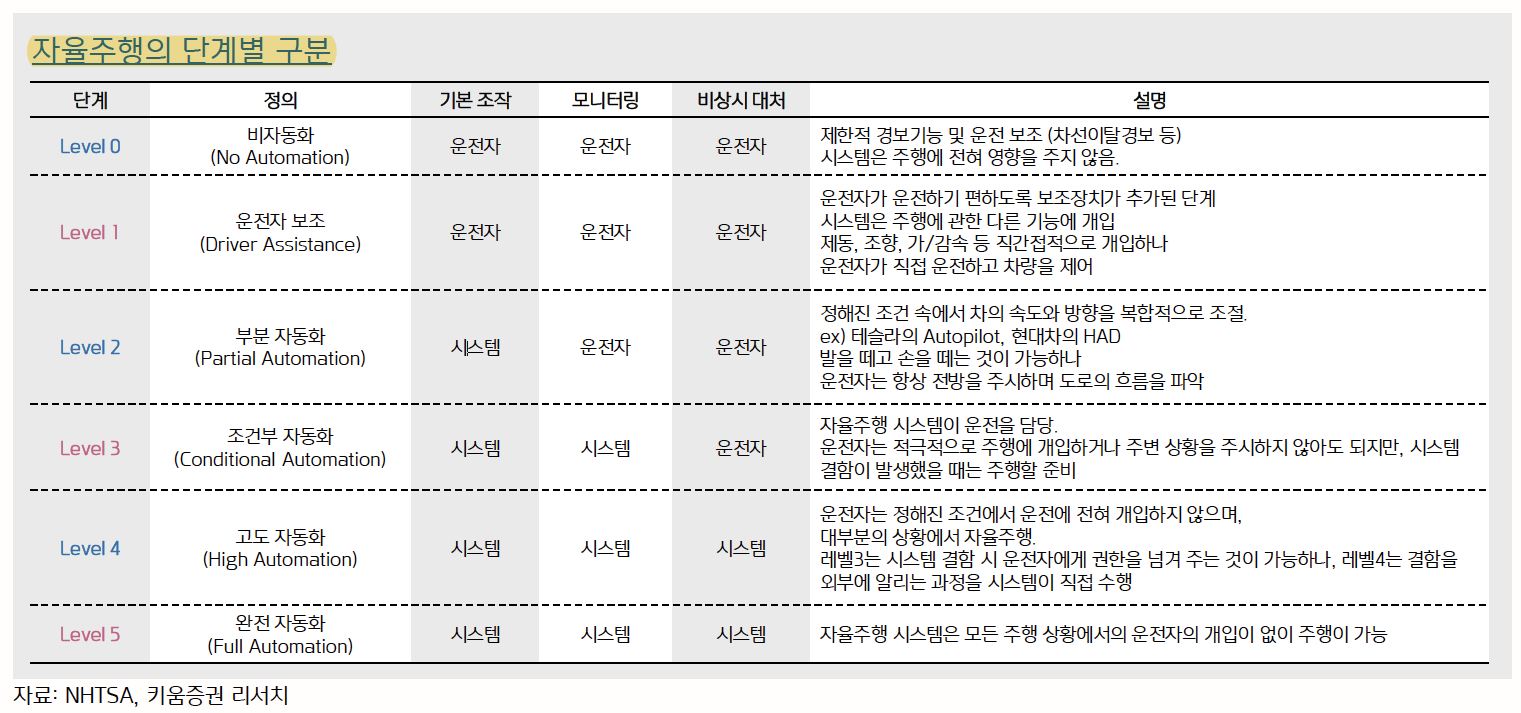

- 자율주행이란 교통수단이 사람의 조작없이 스스로 판단하고 운행하는 시스템. 인지 → 측위 → 경로 계획 → 제어

- 머신러닝은 학습법 지도학습 / 비지도학습 / 강화학습

- 지도학습은 정답이 있는 데이터를 활용해 컴퓨터를 학습시키는 방법, 분류 / 회귀에 활용

- 비지도학습은 정답이 없는 데이터를 비슷한 특징끼리 군집화하며 새로운 데이터를 대한 결과를 예측하는 학습 방식

- 강화학습은 학습 주체가 주어진 환경에서 행동을 취하고, 이로부터 얻어지는 보상을 극대화 하도록 유도하며 학습을 진행

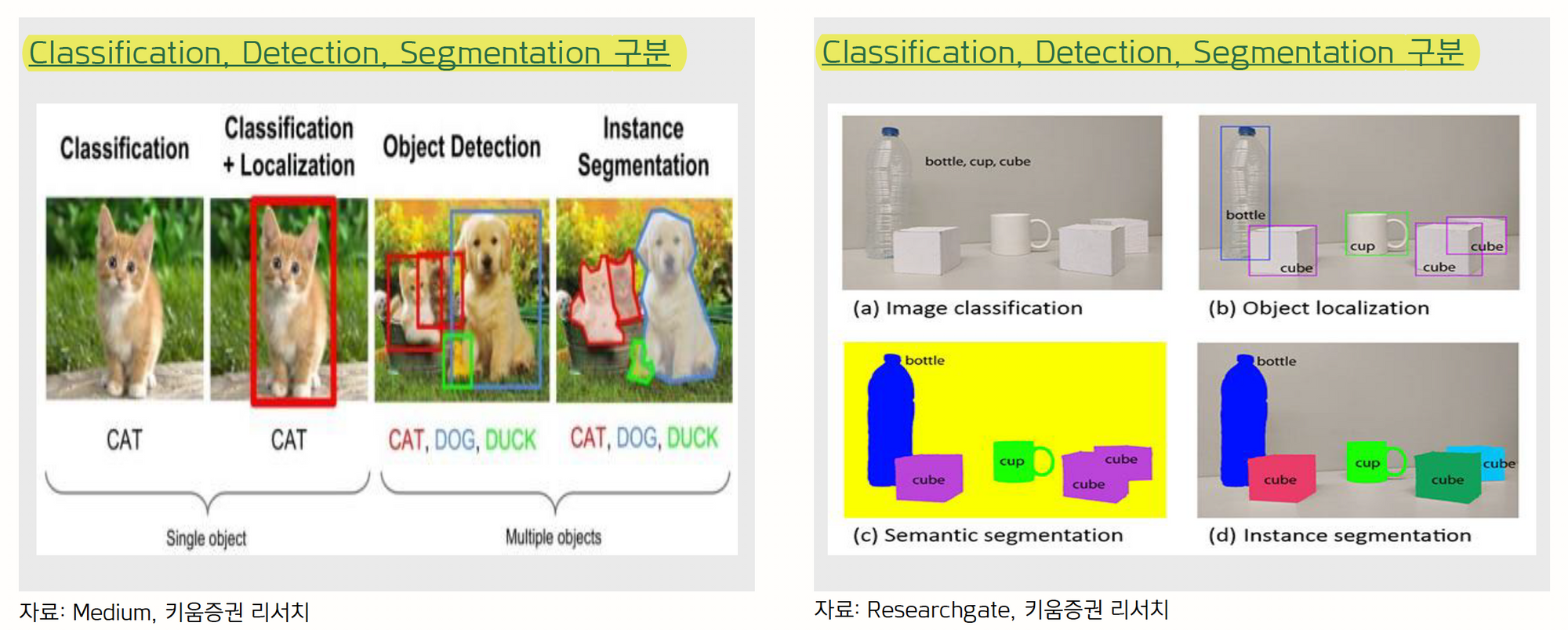

이미지 인식 방법의 차이

컨볼루션 신경망(CNN, Convolutional Neural Network)의 장점으로는 1) 특징을 추출하는 과정과 분류하는 과정에 모두 신경망을 이용해 기계 직접 패턴을 찾고 과정을 학습하는 것 2) 이미지 차원을 축소함으로써 필요한 연산량을 감소시키는 것 3) 특징을 선별하는 것 등이 있음

테슬라의 개발 방향성은

- 차량의 두뇌 역할을 하는 FSD칩의 (HW 3.0) 독자적 개발

- 주행 데이터 수집에 기반한 인공 신경망 설계와 훈련 프로그램 구축 (Dojo)

- Lidar에 의존하지 않는 비전 의식(Pseudo-Lidar) 역량 강화

- FSD 칩 내 중앙집중형 ECU 아키텍처 구현을 통해 OTA(Over-the-Air) 업데이트 제공 등 자율주행 전반에 걸친 독자적 역량 강화에 맞춰져 있음

- 즉 자율주행 인식 → 측위 → 판단 → 제어의 전 과정을 자사의 기술력에 기반한 독자적인 방향성으로 구축

- 테슬라는 자율주행 중 위치에 대한 사전 정보 없이 카메라와 센서에 입력된 이미지를 기반으로 주행

- 자사 차량의 주행 데이터를 수집해 데이터센터에서 관리하며, 모방학습 메커니즘을 사용

- 반면 웨이모, 모셔널 등은 MMS(Mobile Mapping System)를 장착한 차량 및 위성 등이 고화질 지도 (HD Map)를 작성해 도로상황과 지형 정보를 취득한 후, 차량은 Lidar, 카메라, 센서 등을 활용해 주행

- 차량의 판단 메커니즘은 정보 수집 차량이 시행 주험을 통해 얻은 정보를 바탕으로, 주행에 대한 알고리즘을 설정. 이후 시뮬레이터(Carcraft, Cognata 등)에서 강화학습을 통해 학습 진행. 알고리즘 설정에 필요한 데이터 만을 수집하며, 주요 업체 별 주행거리는 웨이모 (21년 기준) 2천만 마일, 바이두 (19년 기준) 180만 마일, 모셔널 (19년 기준) 100만 마일 등으로 테슬라에 비해 주행 데이터 축적이 부족한 상황

강화학습 VS 모방학습(역강화학습)

- 강화학습이란 agent가 행동을 수행할 때마다 피드백으로 보상 함수가 주어지며, 시행착오를 통해 보상함수의 결과 값을 극대화 하도록 유도하는 학습법

- 역강화학습이란 주어진 최적 정책/행동 하에 에이전트의 행동에 따른 보상 함수를 측정하는 학습

- 모방학습과 역강화학습은 유사한 개념이나 보상 함수의 존재가 필요하지 않는 모방학습을 더 넓은 개념으로 이해하면 된다.

- 웨이모, 모셔널 등의 학습 메커니즘은 시뮬레이터 내 주어진 보상함수 조건 하에서 반복 훈련을 통해 차량을 안전 주행으로 이끄는 강화학습의 성격이 강하며, 테슬라의 훈련은 운전자의 주행 데이터를 기반으로 한 모방학습에 초점이 있다.

Lidar가 없어도 된다는 테슬라의 입장

- LIDAR : 인식용 영상 센서. 라이다는 빛을 보낸 후 물체에서 반사되어 돌아오는 광에너지를 분석하여 3차원 정보를 인식하며, 입체 정보를 인식할 수 있다.

- 라이다의 가장 큰 단점은 비싼 가격과 전력 소모

- 라이다는 근적외선을 이용한 탐지 및 거리측정 기술. 빛 파장의 특성을 이용해 레이다로 탐지하지 못하는 것도 정밀하게 구분할 수 있다.

- 테슬라는 카메라 8개, 초음파 센서, 레이더만을 탑재. 라이다를 사용하지 않고도 라이다를 사용한 것과 유사한 결과를 도출해내는 의사 라이다의 개념이 존재

- 카메라의 3D 이미지 인식 능력의 한계를 물체 표현 알고리즘의 조정으로 일정 부분 극복할 수 있음

- Stereo Depth Network (SDN, 카메라가 인식한 2D 이미지의 픽셀 당 depth를 측정하기 이전 단계에서 이미지의 괴리를 최소화 하는 전처리 과정)와 Graph-based Depth Correction(GDC, 이미지에서 측정된 Depth에 K-안전기법을 적용하는 후보정 과정)을 적용한 Pseudo-Lidar++의 개념이 제시됨

- Lidar에 의존하지 않고도 Lidar와 유사한 수준의 3D 이미지 인식이 이론적으로 가능

- 경쟁사가 Pseudo-Lidar를 적용하지 못하는 배경에는, 주행 시 짧은 시간 내 비전 인식과 Depth Estimation, Pseudo-Lidar Representation를 수행하기 위해 요구되는 높은 연산을 처리하는데 최적화된 시스템을 구현하지 못하기 때문으로 분석.

- 테슬라가 독자적으로 개발한 FSD칩 HW 3.0이 이러한 연산을 수행할 수 있도록 최적 설계 되었으며, 칩 설계 역량이 돋보인다는 판단.

- 테슬라는 차세대 칩 HW 4.0 을 4Q21 양산을 목표로 개발중. 디자인은 브로드컴과 협업, 제작은 TSMC. 7nm 공정, 제작비용절감, 사용 전력량 감축 등 새로운 기능이 적용될 것으로 전망

- Software 1.0은 2.0으로 진화하는중. 1.0은 개발자가 수작업으로 코딩을 처리했으나 2.0은 딥러닝을 활용한 인공신경망에 기반해 기계가 직접 입력하는 방식

인공신경망 Hydranet

- 테슬라는 판단 역량 강화를 위해 인공 신경망에 기반한 딥러닝 방식을 적극적으로 활용

- 차량 주행시 8개의 카메라를 통해서 주변 이미지를 인식. 이미지의 대분류(Classification)를 거친 후, 상호간 이미지 특징 값들을 종합

슈퍼컴퓨터 Dojo

- 인공신경망 Hydranet의 이미지 처리 역량은 자기지도학습을 통해 발전. Dojo란 가속화된 자기지도학습을 통해 신경망을 훈련시키는 프로그램으로, 신경망의 성능을 인간이 라벨링 없이 향상시킬 수 있다는 점에서 차별화. Dojo는 엔비디아의 클라우드를 활용

- 테슬라는 10월 22일 FSD 기능을 일부 유저에게 베타 버전으로 공개

- 현대/기아차는 현재 NHTSA 기준 자율주행 2~2.5단계를 공급. 주요 차종 내 AEB, 차로 이탈 방지 보조 기능 등이 기본적으로 탑재되어 있으며, 네비게이션에 기반한 고속도로주행지원시스템(HAD)과 차로이탈방지보조(LKAS), 운전자주의경고(DAW) 등이 스마트 센서(현대차)/와이즈 드라이빙(기아차) 옵션에 포함

- 현대차의 자율주행 메커니즘은 정밀 지도(HD Map)와 전방 카메라, 센서 등을 이용해 물체의 유무를 인식하는데 기반.

- 현대차는 레벨3 ADAS 프로세서로 인텔의 덴버튼을 채택했으며, 모빌아이 EyeQ, 엔비디아 Xavier 등에 비해 가격 및 수급적인 측면에서 강점을 보이는 것이 선택의 배경. 향후 Level 4+ 이상에서 엔비디아 칩을 채택해, HW를 기반으로 SW 커스터마이징을 시현할 것으로 전망

- 현대차는 머신러닝 기반 스마트 크루즈 컨트롤을 개발해 GV80에 첫 적용

- 현대차그룹은 지난해 9월 미국 Delphi에서 분사한 Aptiv와 자율주행 연구를 위한 JV를 설립. (지분율 5:5) 출자 규모는 총 20억달러 (약 2.3조원)

- 합작법인의 사명은 '모셔널(Motional)'로 자율주행 로보택시 상용화 및 자율주행 시스템 개발 계획을 당초 24 → 22로 단축해서 제시

- 최근 Motional은 누씬 데이터에 대한 향상된 access를 제공하기 위해, 독일의 Siasearch와 파트너십을 체결

- 현재 자율주행 연구의 가장 큰 과제는 주행에서 얻는 데이터 중 ML에 필요한 부분을 추출하고 정제하는 과정. 자율주행 차량 1대가 만들어내는 데이터는 1~4TB/day 이나, 이 중 유의미한 부분을 추출하고 영상 내 주석처리(Annotation)를 통한 데이터 정제 과정은 대부분 수작업으로 이루어져 효율성의 한계가 존재.

- Siasearch는 영상의 패턴 분석을 통한 인덱싱을 통해 데이터 정제의 자동화를 제공

- Data Annotaiton 시장은 19년 약 1조달러에서 26년 약 3.5조 달러로 가파른 성장세를 이어나갈 것으로 전망

- 모셔널은 최근 22년 상반기 중 Level 4 수준의 로보택시를 상용화할 계획을 언급. 미국 차량 공유 서비스 기업 Via의 차량 배정, 예약/관리 시스템을 도입할 것으로 전망

- 현대차그룹은 그룹사 차원에서 Motional 외에도 다양한 글로벌 업체들과의 협업, 파트너십을 통해서 역량 강화를 모색

- 현재 차량용 인공지능 프로세싱 칩 시장은 엔비디아와 모빌아이가 양분

- 모빌아이는 ADAS 업체로서 카메라, 레이더 등을 기반으로 한 이미지 처리를 강점으로 자율주행 솔루션에 대한 접근성을 높인다는 전략

- EyeQ 칩은 저전력, 저가라는 범용성을 특징으로 하며, 이미지 프로세싱 SW를 포함한 자율주행 통합 솔루션을 완성차 업체에 제공

- 모빌아이도 자사의 EyeQ 탑재 차량의 실시간 주행정보를 수집. 테슬라가 같은 방법으로 정보를 수집하고 있으며, 현재까지 판매한 차량은 누적 150만대 수준. 모빌아이의 EyeQ 칩은 19년 기준 누적 약 5,400만개 판매 되었으며, 일 평균 600만 km를 수집해 자사 자율주행 알고리즘 개발에 활용

- 모빌아이도 라이다를 활용하지 않고 Vidar 라는 자사 고유의 이미지 인식 알고리즘을 사용. EyeQ 칩 탑재 차량에 부착된 12대의 카메라를 활용해 삼각 측량을 구현하고 이를 통합해 Depth map을 생성

- 그러나 자율주행 개발에서 가장 중요한 부분은 인공지능 의사결정. 현재 EyeQ 칩의 인공지능 훈련 알고리즘은 모빌아이가 독접적으로 개발중인 상황

- 엔비디아는 본업인 GPU 제소사로서의 자사 정체성을 살려 자율 주행 솔루션을 완성차 업체에 공급하겠다는 계획. 자율주행용 칩 DRIVE AGX, 딥러닝 훈련용 슈퍼컴퓨터 DGX SuperPoD, 시뮬레이터 Drive Constellation, 데이터 클라우드 등 인프라 SW 플랫폼에 걸친 자율주행 차량 개발의 수직 통합 value chain

- 엔비디아는 본업인 GPU 제소사로서의 자사 정체성을 살려 자율 주행 솔루션을 완성차 업체에 공급하겠다는 계획. 자율주행용 칩 DRIVE AGX, 딥러닝 훈련용 슈퍼컴퓨터 DGX SuperPoD, 시뮬레이터 Drive Constellation, 데이터 클라우드 등 인프라 SW 플랫폼에 걸친 자율주행 차량 개발의 수직 통합 value chain을 공급

- 현대차 그룹도 18년 초 SW 솔루션 개발과 BE 솔루션 개발에 강점에 있는 오로라(Aurora Innovation)과의 협업을 발표

Lidar 제조사의 방향성

- Lidar 주요 제조사로서 Velodyne, Luminar, Quanergy 등이 있음. 특히 Velodyne은 현대모비스가 19년 10월 5000만달러의 지분투자를 통해 라이다 양산에 관련한 기술 협력에 합의함.

- Velodyne 초창기 라이다 가격은 7.5만달러 수준이었으나, CES 2020에서 고정형 라이다 밸라비트(Velabit)를 약 100달러에 선보이며 대중화에 대한 강한 의지를 보였으며, Luminar 도 테스트, 개발용 제품인 Hydra 출시 이후 2022년 부터 상용화 제품으로 Iris를 출시할 계획 (약 $1,000)

- Velodyne은 Graf Industrial과 SPAC 합병 상장. Ford는 최근 Velodyne 지분 7.6% 인수를 발표했고, 바이두도 자율주행 차량 내 Velodyne 라이다 탑재 등을 발표

- Velodyne의 3Q 실적 발표를 통해 몇 가지 시사점을 도출

- 분기 Lidar 출하량 2,235개 ASP 5,600 달러를 기록 (누적 출하량 47,500개, 누적 매출 6.5억달러 평균 ASP 13,684만 달러) 과거 대비 Lidar 가격이 빠르게 낮아지고 있다. 회사는 IPO 당시 22년, 24년까지 Lidar 평균 가격을 1,000달러 700달러로 낮추겠다는 계획을 제시함

- 그러나 자동차 평균 판가, OPM, 자율주행 구현에 필요한 라이다 숫자 등을 고려하면, 개당 평균 판가 5,600달러는 대중화에 부담스러운 수준

- 라이다 제조사들이 자율주행 value chain 내에서 유의미한 역할을 하기 위해서는 1) 라이다 가격의 하락을 통한 대중화와 2) 물체 인식 도구로서의 라이다 공급 이외에도, 수집된 주행 데이터를 검출, 주석 등 데이터 정제 기능을 함께 공급하며 통합 솔루션 업체로서 진화하는 것이 필요하다는 생각

- 라이다 판가의 더딘 하락으로 인해 대중화가 지연된다면, ADAS Level 2, 3 수요가 더욱 가파르게 성장할 수 있다는 판단. ADAS 주요 제품 공급에서 글로벌 경쟁력을 갖춘 만도의 역할도 지속적으로 확대될 것.

- 만도는 ADAS 제품 군 공급에서 글로벌 경쟁사(현대모비스, 보쉬, 앱티브 등) 대비 가장 높은 수준의 수익률을 기록하는 것으로 추정.

- 향후 수주 결과를 기반으로 한 현재/기아차 향후 공급 비중은 현재에 비해 오히려 늘어날 것으로 전망되며, 20년 3Q ADAS 신규 수주 중 현대/기아차를 제외한 기타 OEM 수주 비중이 80%에 달하는 것을 감안했을 때, 중~장기적 관점에서 현대/기아차 물량 유지와 고객사 다변화라는 두 가지 목표의 달성이 가능할 것으로 판단

OTA의 필요성

- 테슬라가 기존 OEM 대비 독자적인 행보로 자율주행에서 공격적인 개발이 가능했던 배경은 OTA 업데이트를 통해 제품 출시 이후 성능을 보완할 수 있었기 때문으로 분석

- OTA를 가능하게 하는 기술적 필요조건은 ECU(Electronic Control Unit)의 중앙집중식 배치를 통한 제어. ECU란 자동차의 엔진, 자동변속기, ABS 등의 주요 부품을 컴퓨터로 제어하는 전자제어 장치로, 출시 초기에는 엔진 연료 분사의 정확성을 위해 출시. 그러나 전장 부품의 보급화로, 조향, 제동 등 주요 부품 당 ECU가 1:1로 부착되는 분산형 배치가 확산되며, 게이트웨이 배치가 유행해 차량당 30개에서 110개까지 탑재

- 테슬라는 ECU를 3개만 탑재OTA가 가지는 의미는 단순한 요식적 의미의 업데이트가 아니라, 1) ECU → Actuator → 구동으로 이어지는 자동차 작동 메커니즘을 재정의 하는 의미. 2) 자사 제품의 기능에 대한 수정을 가능하게 해 기술에 공격적인 개발을 허용하는 의미

- 현재까지 OTA 기능이 제한되었던 것은 1) 제도적인 한계와 2) 현재의 분산형 ECU에 대해 개별 업데이트를 진행 시 부품별 작동 조합의 최적화가 어긋나며 안전상의 문제가 발생할 수 있기 때문

- 현대차는 내년 상반기 출시 예정인 아이오닉5, G80 전기차 등에 AVNT 인포테이먼트 OTA 기능을 탑재할 계획이며, 22년 출시 예정인 아이오닉6에 제어기에 대한 OTA를 탑재할 것으로 전망. 삼성과의 협업 등을 통해 경쟁사 대비 빠른 대응이 가능할 것으로 전망

'주식 공부 기록하기 > 01. 산업분석' 카테고리의 다른 글

| [철강 산업리포트] 2021 05 25 하나금투 - 산업의 구조적인 변화에 베팅할 때! (0) | 2021.06.09 |

|---|---|

| [자동차 산업리포트] 2021 03 02 이베스트 - 자동차 전기차 모멘텀 확산 시작 (0) | 2021.05.16 |

| [신탁사 산업리포트] 2018 09 27 삼성증권 - 토지신탁 : 실적 안정성 토대 위 새로운 성장원 추가 (0) | 2021.04.06 |

| [신탁사 산업리포트] 2018 07 24 한투 - 별들의 전쟁 (0) | 2021.04.06 |

| [신탁사 산업리포트] 2017 03 07 교보증권 - 부동산신탁 매력이 돋보이는 시기 (0) | 2021.04.03 |